M

June 03, 2023

本文旨在按字母顺序对团队研究过程中涉及的术语进行分类解释,为对该领域感兴趣的读者提供一份全面的术语表。

mAP(mean average precision)

++Need to Fill++

Markov Chain

马尔可夫性质(Markov property)指的是离散时间随机过程(discrete-time stochastic process)。 一个状态(state)的概率只取决于它的前一个状态,这是关键点。换句话说,从一个状态到另一个状态的转移不需要考虑长时间的状态转移历史,而是可以直接根据前一个状态的转移进行估计。

Maximum A Posterior(MAP)

在一个班级里,假设有10个男生和5个女生。现在我们可以考虑两种情况:一是男生中身高超过170的学生的概率,二是身高超过170的学生中是男生的概率。如果我们知道其中一种情况,那么对于相反的情况,我们可以近似地推断出来。 在这个例子中,假设我们已经知道了男生中身高超过170的学生的概率P(身高>170|性别=男),那么这就是我们想要知道的后验概率。 在这里,已知的男女比例是先验概率,已知的信息是似然概率,而我们想要知道的是后验概率。 ++Need to Fill++

Maximum Entropy Model(MEM)

在自然语言处理领域,Multinomial Logistic Regression被称为最大熵模型(Maximum Entropy Model)。 最大熵模型的核心是特征向量。由于可以积极地将研究人员的语言学先验知识纳入模型中,因此相对于只能在初始值设置阶段进行干预的隐马尔可夫模型等,最大熵模型具有优势。 (当然,由于需要研究人员手动指定特征,因此也被认为是最大的弱点)。然而,最大熵模型的缺点是它不像隐马尔可夫模型那样是序列分类器。它只能对单个观测值进行预测,而不是序列。

Maximum Entropy Markov Model(MEMM)

最大熵隐马尔可夫模型(Maximum Entropy Markov Model,简称MEMM)是将最大熵模型(Maximum Entropy Model)与隐马尔可夫模型(Hidden Markov Model)相结合的一种模型。 MEMM利用最大熵模型的灵活特征利用能力,实现了序列分类的能力。它假设隐藏状态遵循马尔可夫链,但在序列预测中利用了首字母、分词等多种特征的方式。

Maximum Likelihood Estimation(MLE)

寻找使得似然函数(Likelihood)最大化的参数的问题。 ++Need to Fill++

Mean Squared Error(MSE)

均方误差(Mean Squared Error,简称MSE)是一种常见的代价函数之一。它通过将模型的预测值与实际目标值之间的差值平方并求和,然后取平均值来定义。它被用作衡量模型性能的指标。换句话说,MSE越小,模型就越好。

Median Filter

中值滤波器(Median Filter)主要用于从图像或信号中去除噪声,通常在图像处理的预处理阶段使用。 例如,在执行边缘检测之前,可以使用中值滤波器来去除图像中的噪声。特别是对于去除Salt&Pepper噪声效果出色,并且边缘模糊较少,因此非常有用。例如,当滤波器尺寸为3x3时,它将对相邻的9个像素进行排序,并取其中位数作为输出值。

Meta Learning

++Need to Fill++

Metric

度量(Metric)指的是衡量标准或指标,用于表示通过学习实现目标的程度(即需要进行优化的目标)或本身具有有意义的数值。例如,距离度量用于表示两个点之间的距离,常见的距离度量包括欧氏距离、马哈拉诺比斯距离、曼哈顿距离等。 即使是相同的两个点,根据使用的度量方式不同,其距离的表示也会有所差异。同样,根据使用的度量方式不同,模型的性能也会以不同的方式表示。

Metric Learning

在表示两点之间的距离时,根据情况可以应用不同的距离度量,如欧氏距离、马哈拉诺比斯距离等。然而,��根据所使用的度量方式,可能会对模型的性能产生影响,因为这些度量方式本质上只能表示两个点之间的关系,而不适用于表示实际数据之间的关系。 度量学习(Metric Learning)的出发点在于重新定义这些距离度量。 在向量空间中,通过学习使得语义上相似的点聚集在一起,而不相似的点则远离,从而调整度量方式。通过这种方式,无论数据的结构如何,都可以通过特征之间的关系推导出适合情况的度量方式。

Mini-batch

在进行更新(Update)时,小批量(mini-batch)的方法是将整个数据集分成小块逐步使用的概念,而不是一次性使用整个数据集。然而,小批量集合的选择应尽可能保证其中的数据之间的相关性较小,以确保其能够代表整个数据集。 换句话说,如果使用了偏向于整个数据的某个部分的数据,则无法保证代表性,因此应选择分布均匀的数据。

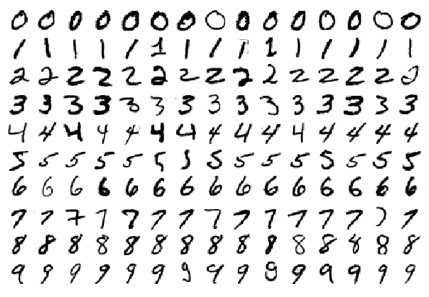

MNIST

学习机器学习的人接触到的第一个数据集。它是机器学习的 “Hello World”。它由 60,000 个训练数据和 10,000 个测试数据组成,包含 28×28 幅手写图像,数字范围在 0 到 9 之间。 可从 http://yann.lecun.com/exdb/mnist/ 下载。

Model-agnostic

++Need to Fill++

Momentum

动量(Momentum)是指在通过梯度下降(Gradient Descent)寻找最优解时,给参数向量(Parameter Vector)的速度引入一种惯性的方式。 这个概念起源于从物理学的角度来看待优化问题(Optimization Problem)。在优化过程中,当参数向量被更新时,可以将其类比为在山坡上滚动物体的过程。

- 势能(Potential Energy,U=mgh)= 损失函数(Loss Function)

- 将物体放在山坡上而不给予速度 = 参数的初始值(Initial Value)设置

- 作用在物体上的力与势能的梯度(Gradient)大小相同 = 作用在参数向量上的力与损失函数的梯度大小相同。从物理角度来看,动量更新仅直接影响速度,并且速度影响位置值。使用动量更新时,参数向量除了在更新方向上,还会记住之前的移动方式,并带有该方向上的惯性进行移动。

Multi-Scale image

我们通常会用特定区域的数值来描述物体。例如,树枝的长度可以用厘米到米的单位来讨论,而不需要使用纳米或千米的单位。相反,这更接近于构成叶片的分子,以及树木生长的森林单位。 换句话说,数值可以是描述物体的多种方式。这个概念在制作地图时经常在比例尺的概念中使用。当设计从现实世界中提取信息并自动进行分析的方法时,多尺度表示是必要的。