H

June 03, 2023

本文旨在按字母顺序对团队研究过程中涉及的术语进行分类解释,为对该领域感兴趣的读者提供一份全面的术语表。

He et.al Initialization

Kaiming He等人提出的这种初始化方法类似于Xavier初始化,并且将系数乘以2。权重是根据前一层的大小进行随机初始化的,能够更快、更有效地找到损失函数的全局最小值。 通过控制初始化,它提供了更快、更有效的梯度下降。

Heuristic

启发式(Heuristic)一词的意思是“to discover”。换句话说, 它指的是在信息不完全的情况下,通过试错或经验法则来获取知识,而不是依靠已经建立的公式。 有时也被称为善于猜测的艺术。从这个角度来看,启发式与算法(Algorithm)相对立。虽然启发式不能保证找到解决方案,但它可以排除许多无用的替代方案,而无需直接尝试所有可能,因此被认为比算法更高效。 启发式方法并不理想,但它是指尝试多种方法,直到找到合适方法的方式。

Hidden Layer

隐藏层(Hidden Layer)是与可见层(Visible Layer)相对的概念,在神经网络中指位于输入层(特征)和输出层(预测)之间的合成层。通常,神经网络中包含一个或多个隐藏层。

Hidden Markov Model(HMM)

隐藏马尔可夫模型(Hidden Markov Model,HMM)假设每个状态遵循马尔可夫链,但状态是隐藏的。假设你是一个研究100年前气候的学者,给定的信息只有当时的冰淇淋消费记录。 你想知道当时的天气是炎热的、寒冷的还是温暖的。虽然我们可以观察到冰淇淋消费的连锁关系,但直接观测到特定日期的天气是困难的。 隐藏马尔可夫模型的目的就是基于观测值来推断后面隐藏的状态。HMM本质上是序列分类器。它利用前一个状态到当前状态的转移概率和当前状态下观测到特征的发射概率,找到在给定观测到的单词序列W的情况下,最有可能的隐藏状态序列T。

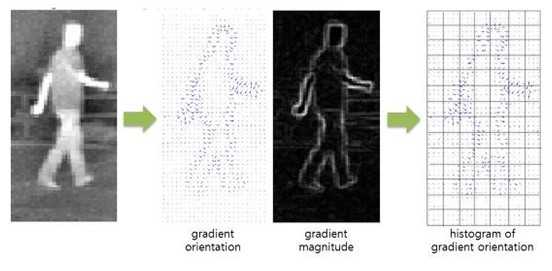

HOG(Histogram of Oriented Gradient)

HOG(Histogram of Oriented Gradient)是一种用于检测图像特征的算法之一。 它将目标区域分割为固定大小的单元格,并计算每个单元格中边缘像素(梯度幅值大于某个阈值的像素)的方向直方图,然后将bin值按顺序连接成向量。 换句话说,HOG可以视为边缘方向直方图模板。直方图匹配可以在目标形状变化时进行匹配,但由于只记住分布(组成比)信息而丢失了几何信息,因此可能会出现与错误目标匹配的问题。HOG可以看作是在模板匹配和直方图匹配之间的中间阶段匹配方法,它在块级别上保持几何信息,同时在每个块内部使用直方图,从而具有对局部变化相当鲁棒的特性。 HOG作为一种模板匹配方法,在物体旋转或形态变化较大的情况下检测困难,适用于形态变化不大、内部模式简单且可以通过物体轮廓线识别物体的情况。

Hyperparameter

在进行机器学习算法的训练之前,需要人工手动指定的值被称为超参数(hyperparameter)。 例如,对于梯度下降算法,学习率(learning rate),以及在成本函数中添加正则化时的正则化权重(regularization weight)等都属于超参数。 适当的超参数值需要在进行机器学习算法的训练之前由人工手动指定,而参数则是在学习过程中由机器学习算法自动找到的适当值。