C

June 03, 2023

本文旨在按字母顺序对团队研究过程中涉及的术语进行分类解释,为对该领域感兴趣的读者提供一份全面的术语表。

Captioning

图片说明 + 标签

CIFAR-10 (CIFAR-100)

CIFAR-10和CIFAR-100是包含8000万个标记图像的小型数据集。这些数据集是由AlexNet的Alex Krizhevsky等人收集的。

CIFAR-10数据集包含了10个类别,每个类别有6000张图像,总共包含60000张32X32像素的彩色图像。数据集由50000张训练图像和10000张测试图像组成,训练批次和测试批次的比例为5:1。 测试批次包含了每个类别随机选择的1000张图像,而训练批次则随机顺序包含了每个类别的其余5000张图像。因此,训练批次中可能包含更多来自特定类别的图像。 各个类别是完全互斥的,即“汽车”和“卡车”之间没有重叠。其中,“汽车”包括轿车和SUV等,而“卡车”仅包括卡车。两者都不包括小型货车。

CIFAR-100与CIFAR-10相同,只是每个类别包含了600张图像。每个类别由500张训练图像和100张测试图像组成。 CIFAR-100的100个类别可以重新分为20个超类。每个图像都附带有“细粒度(fine)”标签(图像所属类别)或“粗粒度(coarse)”标签(图像所属超类)。

Classification

图像分类是计算机视觉问题,其目标是将图像根据预先定义的类别进行分类,以确定其主题或物体。例如,向孩子展示图像��闪卡,并询问其中绘制了什么物体。 这种问题涉及到判断图像代表的是0到9之间的哪个数字,或者图像是狗还是猫等。这就是分类问题。

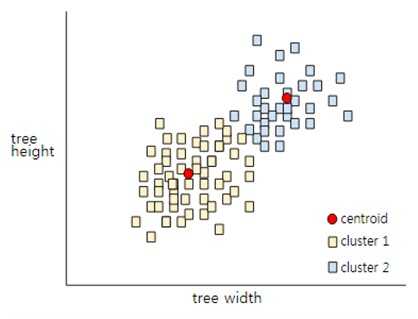

Clustering

无标签数据的聚类是一种在无监督学习中使用的方法。当所有数据被分组后,人们可以选择性地为每个聚类分配标签。k-means算法是聚类的一种方法,根据每个数据点与其最近的中心点的接近程度来进行聚类,如下图所示。

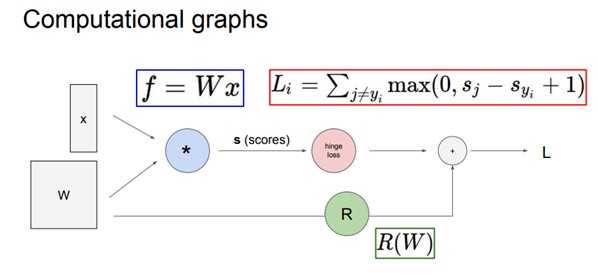

Computational Graphs

计算图是一个有向图,其中的每个节点可以是操作(operation)或变量(variable)。变量节点的值可以被传递给操作节点进行计算,而操作节点的输出又可以传递给另一个操作节点。因此,计算图的所有节点都被定义为某个变量的函数。

Concave

凹函数(Concave function)是一种形状向上凸起的函数,具有唯一的局部最大值(Local Maximum),并且与全局最大值(Global Maximum)相等。 举个简单的例子,可以考虑一个n形状的函数。对于无法仅通过上凸(Concave)或下凸(Convex)来定义的函数形式,无法将其区分为上凸(concave)或下凸(convex)。

Conditional Random Field

CRF(Conditional Random Fields)是一种基于标签相邻性信息进行标签推断的模型。考虑到给定数据(X)时获得标签(Y)的任务。 例如,在图像分割中,数据可以是像素值(RGB直方图),而标签则可以是每个像素的类别(草地、天空、水、牛)。在文本中,数据可以是每个字符的单词,而标签则是该单词的类别(人物、地点、组织)。 使用传统方法(朴素贝叶斯)进行这样的任务时,特征之间被假设为独立的,忽略了它们之间的相关性。为了表示它们之间的相关性,可以将每个特征视为节点,并通过边连接它们,从而使网络变得非常复杂。 相反,CRF不需要关注输入变量之间的相关性。换句话说,它通过给定的(X)来建模(Y)的概率分布,而不需要明确建模(P(X))(而不是建模(P(X,Y)))。 举个例子,假设有一系列拍摄了贾斯汀·比伯(Justin Bieber)一天活动的照片。您需要对这些照片进行标记,以了解他在进行什么活动(吃饭、睡觉、开车等)。 一种方法是只看一张图片进行标记。例如,如果是暗图片,则可能会认为他在睡觉,如果是明亮的图片,则可能会认为他在跳舞。然而,如果仅仅忽略连续属性进行分类,将会丢失很多信息。 那么,如果能够查看标记之前拍摄的照片并进行标记呢?例如,如果那张照片里他张开了嘴巴,那么当前的照片更可能是他在打哈欠或者吃东西,而不是跳舞。换句话说,为了提高标记的准确性,CRF模型利用相邻信息进行标记。

Confusion Matrix

在进行细致的错误分析时,可以使用混淆矩阵(Confusion Matrix)。通过观察混淆矩阵, 可以清楚地了解分类器将哪些类别混淆为其他类别的倾向。 下表展示了二分类(Binary Classification)的混淆矩阵,其中()表示被正确地分类为类别(C_1)的样本数量,()表示被正确地分类为类别()的样本数量,()表示被错误地分类为类别()的样本数量, ()表示被错误地分类为类别()的样本数量。从表中可以看出,二分类的结果可以分为四种情况。将样本正确地分类为()的为真正例(True Positive,TP),将样本正确地分类为()的为真负例(True Negative,TN), 将样本错误地分类为()的为假阴性(False Negative,FN),将样本错误地分类为()的为假阳性(False Positive,FP)。通过混淆矩阵,可以计算出精确度(Precision)、召回率(Recall)等用于评估模型�性能的多个指标。

Convex function

凸函数是指具有向下凸起形状的函数,其局部最小值(Local Minimum)是唯一的,并且与全局最小值(Global Minimum)相等。一个简单的例子是U型函数。

Cost Function

成本函数(Cost function)是评估假设(Hypothesis)的准确性的标准。它表示实际值与预测值(假设)之间的差异。字面上,它是一个成本函数,因此我们希望尽量将其最小化。 有时将其视为损失函数(Loss function)的同义词,但成本函数比损失函数更广泛或更一般的概念。 例如,成本函数可能包括对模型复杂度进行惩罚的概念,这是损失函数不具备的。例如,成本函数可以将整个训练数据集上的损失函数总和与模型复杂度的惩罚相结合。

Convolution

通过对前一层的每个滤波器进行卷积操作,可以得到特征图(feature map)。这些特征图反映了前一层和滤波器之间的相似度(即有多相似)。每个滤波器通过卷积运算被替换为下一层的特征图的每个通道。

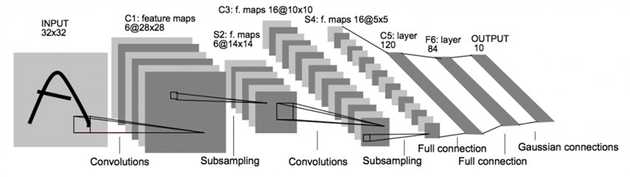

Convolutional Neural Networks(CNN)

一般的卷积神经网络(Convolutional Neural Network,CNN)由卷积层(Convolution Layer)、下采样(池化)层(Subsampling/Pooling Layer)和全连接层(Fully Connected Layer)构成。它们被用于有监督学习(Supervised Learning)。传统的神经网络在处理输入数据尺寸增大时,存在计算量呈几何级增长的问题。因此,为了处理像图像这样输入数据维度较大的情况,提出了卷积神经网络。CNN通过卷积层从原始输入数据中提取有意义的特征,然后通过下采样(池化)层减小从卷积层提取的结果的维度。这个过程被重复执行,直到最后的全连接层,通过压缩后的特征进行分类等预测。目前,CNN是在大多数可应用深度学习的任务中广泛使用且最受欢迎的模型结构。

一般的卷积神经网络的架构

Corpus

语料库(corpus)是自然语言处理中常用的术语,指的是为特定目的而提取的大型语言数据集。

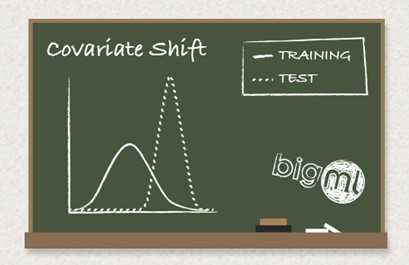

Covariate Shift

在训练过程中,由于前一层参数的变化,导致当前层输入的分布发生变化的现象被称为内部协变量移位(Internal Covariate Shift)。 在训练过程中,当前层的输入受到前面所有层参数变化的影响,随着网络层数的增加,参数变化的影响会被放大,对后面的层产生更大的影响。结果就是训练数据和测试数据的数据分布不同。 可以将其比喻为戴着耳塞,通过观察对方的嘴形来猜测对方说了什么的游戏。为了解决这个问题,提出了白化(whitening)和批归一化(Batch Normalization)的方法。

Cross-Entropy Function

在神经网络中,有一个被广泛使用的成本函数。下面是其定义:

如果使用均方误差(Mean Squared Error, MSE)作为成本函数,那么不会出现神经网络学习速度减慢的问题,因此它比MSE成本函数更常用。

Cross Validation

交叉验证(Cross Validation)是一种评估模型性能的方法。在总数据大小为5的情况下,将其中4个作为训练数据,剩下的1个作为测试数据,通过不同的训练数据和测试数据的组合来训练5个模型,并测量其准确性。 然后计算这5个模型的准确性的平均值作为模型的准确性指标。同时,还计算标准差作为衡量模型稳定性的指标。